Google continue de repousser les limites de l’intelligence artificielle avec sa nouvelle fonctionnalité, qui permet à l’IA Gemini de « voir » ce qui se passe autour de nous, grâce à la caméra de nos smartphones. Une avancée majeure qui s’inscrit dans le cadre du mystérieux Projet Astra et qui commence à faire son apparition chez certains abonnés de Google One AI Premium.

L’IA qui analyse son environnement

L’une des nouvelles fonctionnalités de Gemini Live (la version vocale de l’IA de Google) permet désormais d’utiliser l’appareil photo de son téléphone pour montrer son environnement à l’IA. Concrètement, il devient possible de poser des questions à Gemini sur des objets qui nous entourent : un monument que l’on observe, une couleur précise, ou encore pour comparer plusieurs vêtements avant de faire un choix. Cette capacité à interagir avec l’environnement via la caméra transforme la manière dont nous pouvons interagir avec l’IA.

Actuellement en phase de déploiement, cette fonction est réservée aux abonnés payants de Gemini, mais comme pour les autres fonctionnalités liées à l’IA, il est fort probable qu’elle soit accessible au plus grand nombre dans un futur proche. Google a toujours favorisé l’accessibilité de ses technologies, et cette option ne fait pas exception : on peut désormais utiliser Gemini sans même être connecté à son compte Google.

L’IA qui « lit » l’écran

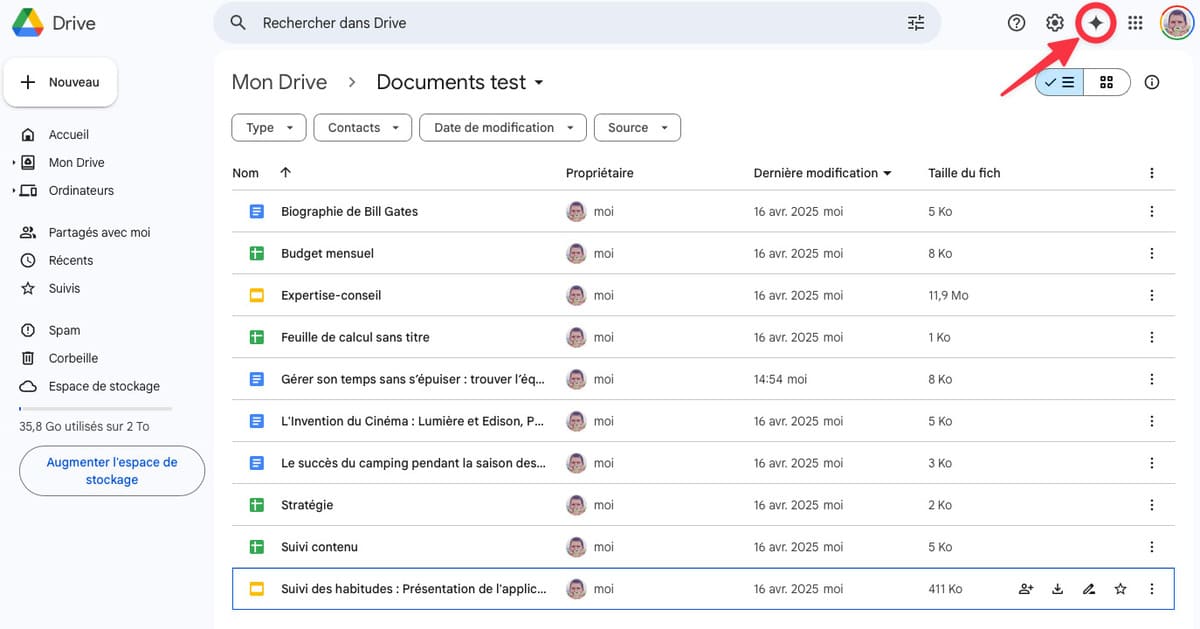

Dans la continuité de cette volonté de rendre l’IA plus immersive, Google a récemment lancé une nouvelle fonctionnalité de partage d’écran avec Gemini. Un utilisateur sur Reddit a montré cette option sur un smartphone Xiaomi, où l’IA décrypte ce qui se trouve sur l’écran d’accueil du téléphone. Gemini identifie les applications présentes, signale la présence de notifications et peut répondre à des questions sur le contenu affiché.

Cependant, cette fonctionnalité présente aussi certaines limitations. Par exemple, lorsqu’un utilisateur demande à Gemini de lancer une vidéo YouTube (une application absente de l’écran actuel), l’IA admet son incapacité à effectuer cette tâche et se contente de proposer des idées orales concernant le contenu visible. Ces premières étapes montrent que, même si l’IA devient plus performante, elle n’en est pas encore à pouvoir interagir totalement avec tout ce qui se trouve sur l’écran.

Un assistant virtuel plus puissant sur Android

Avec la montée en puissance de Gemini, cette IA pourrait bien remplacer progressivement Google Assistant sur les smartphones Android. Déjà intégré sur les nouveaux modèles, comme le Samsung Galaxy S25, Gemini permet d’interagir directement avec les applications sans avoir à les ouvrir manuellement. En quelques mois, il pourrait devenir un outil incontournable, offrant une expérience plus fluide et intuitive aux utilisateurs.

Gemini ne se contente pas de répondre à des questions : elle commence à comprendre et à interagir de manière plus intelligente avec son environnement numérique, et cela ne fait que commencer. Cette évolution montre la direction vers laquelle se dirige Google, visant à rendre l’intelligence artificielle de plus en plus immersive et utile dans la vie quotidienne.